機械学習におけるトレーニングバイアスへの取り組み

「公平さ」について誰かに教えることは称賛に値する目標です。

人間として、私たちは必ずしも公正なものに同意するとは限りません。それは時々文脈に依存します。家庭でも学校でも公平であるように子供たちに教えることは基本ですが、言うのは簡単です。このことを念頭に置いて、私たちは社会として、「公平である」というニュアンスを人工知能(AI)システムにどのように伝えることができるでしょうか。

IBM Researchの研究者チームは、この難問に最初の亀裂を入れています。 IBMは、「AIFairness360」と呼ばれる開発者向けのツールキットを展開しています。この取り組みの一環として、IBMは、企業がAI駆動型システムの動作をテストおよび検証するために使用できる、新しい「クラウドベースのバイアス検出および軽減サービス」を企業に提供しています。

EE Timesとの電話インタビューで、IBMResearchのフェローであるSaskaMojsilovicは、科学者とAI実践者がAIの精度に焦点を合わせすぎていると語りました。通常、人々がAIについて尋ねる最初の質問は、「機械は人間を打ち負かすことができるか」です。

しかし、公平性についてはどうでしょうか? AIの公平性の欠如は、たとえば医療や自動運転車に壊滅的な結果をもたらす可能性があると彼女は述べています。

マシンのトレーニングに使用されるデータセットにバイアスがかかっている場合はどうなりますか? AIが決定に至った経緯を説明できない場合、AIの「正当性」をどのように検証できるでしょうか。 AIは、AI処理中にデータが何らかの形で操作されたかどうかを明らかにできますか? AIは、前処理中や後処理中を含め、データが攻撃されたり侵害されたりしたことがないことを保証できますか?

要するに、内省的なAIのようなものはありますか?簡単な答え:いいえ。

AIユーザー、開発者、実践者に対して透過的でなければ、AIシステムは社会からの信頼を得ることができないとMojsilovic氏は述べています。

分解の公平性

より大きな問題は、公平性とは何かを機械にどのように教えるかです。モジシロビッチ氏は、「私たちは科学者であるため、最初に行ったのは「公平性」を分解することでした。私たちはそれを回避する必要がありました。」彼らは、AIの実装で実践されている指標、アルゴリズム、バイアスの観点から公平性を打ち破りました。

IBMのリサーチサイエンティストであるKushVarshneyは、チームはAIアルゴリズムとAIの意思決定におけるバイアスと公平性に注目していると説明しました。 「個人には公平性があり、グループには公平性があります。性別から人種まで、グループのさまざまな属性を調べました。法規制の問題も考慮されます。」最終的に、チームはデータセット、AIモデル、アルゴリズムのバイアスを探すために30の異なる指標を測定することになりました。

これらの調査結果は、IBMが今週立ち上げたAI Fairness360ツールボックスに組み込まれています。同社は、これを「データセットと機械学習モデルの不要なバイアスをチェックするためのメトリックの包括的なオープンソースツールキット」と説明しました。

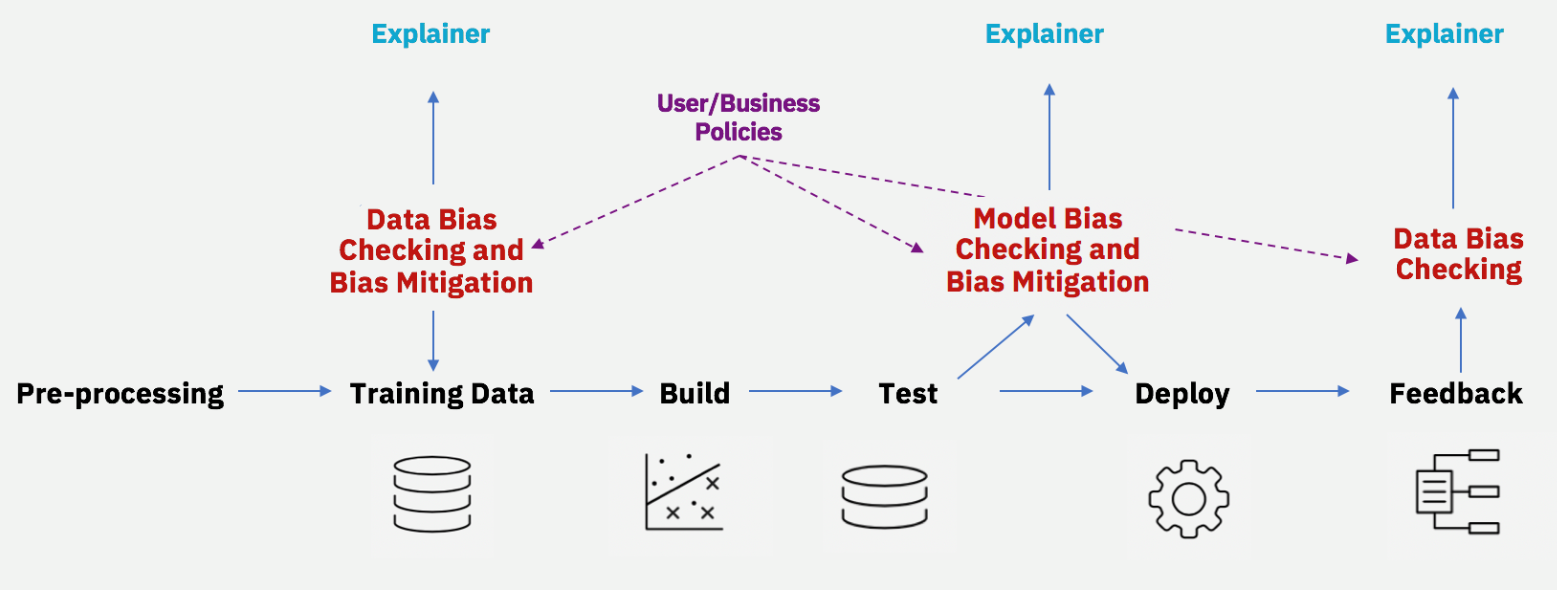

AIライフサイクル全体にわたるバイアスの軽減(出典:IBM)

多くの科学者がすでにAIアルゴリズムの差別を発見するために取り組んでいますが、Mojsilovic氏は、IBMのアプローチは、バイアスを見つけるだけでなく、バイアスを取り除くためのツールも含めることで異なると述べました。

基本的なレベルでは、次のように質問する必要があります。コンピュータ科学者—公平性を定義しますか?これは通常、社会科学者に割り当てられているタスクですか?この不一致を認識して、IBMは、MojsilovicもVarshneyも真空状態で作業していないことを明らかにしました。彼らは多くの学者や研究所を連れてきました。ヴァーシュニーは、カーネギー国際関係倫理評議会が主催する上広-カーネギー-オックスフォード倫理会議に参加しました。 Mojsilovicは、カリフォルニア州バークレーで開催されたUC Berkeley LawSchoolが主催するAIワークショップに参加しました。

アルゴリズムは中立ですか?

社会科学者は、しばらくの間AIバイアスの問題を指摘してきました。

ウィスコンシン大学マディソン校のジャーナリズムとマスコミュニケーション学部の教授であるYoungMie Kimは、次のように説明しています。年齢、社会的/経済的地位など)。」例は、サンプリングエラー(たとえば、サンプリング方法が不適切または困難であるために特定の人口統計が過小表示されている)から、機械トレーニング(モデリング)における人間の偏見にまで及びます。キムは、AIバイアスは、政治広告アルゴリズムなどの設計やモデリングにおける「戦略的決定」にも存在すると主張しました。

「アルゴリズムの機会:デジタル広告と政治的関与の不平等」というタイトルの最近の研究で、キムはアルゴリズムベースの意思決定で不平等をどのように強化できるかを示しました。

技術コミュニティは、「アルゴリズムは中立」であるか、「教育」(トレーニング)できると主張するかもしれません。キムは、「それは、バイアスがアルゴリズム開発のどの段階でも入ることを認めていません。」と述べました。

モノのインターネットテクノロジー